Worum geht's?

Mit der zunehmenden privaten und geschäftlichen Nutzung von KI-Technologien wie ChatGPT rückt das Thema Datenschutz immer mehr in den Fokus. Nicht wenige Menschen und Unternehmen fragen sich: Wie sicher sind die Daten, die man mit der künstlichen Intelligenz teilt? Trotz Sicherheitsmaßnahmen wie der verschlüsselten Datenübertragung und Möglichkeiten, die Datenverwendung zu Trainingszwecken zu unterbinden, gab es in der Vergangenheit wiederholt Datenpannen bei ChatGPT. Doch wie ist der aktuelle Stand? Kann man ChatGPT als Unternehmen datenschutzkonform nutzen?

1. Wie steht es um den Datenschutz bei ChatGPT?

Im Fokus beim Thema ChatGPT und Datenschutz stehen die Prompts – also die Eingaben, die Nutzer im Chat eintippen, um eine Konversation mit der KI zu führen. Zu diesen menschenähnlichen Gesprächen ist der Chatbot in der Lage, weil er aus einer immensen Menge an Daten lernt. Der Textkorpus setzt sich zusammen aus Artikeln, digitalisierten Büchern, Wikipedia, Magazinen und Websitetexten.

In den früheren Versionen von ChatGPT wurden die Prompts zu Trainingszwecken verwendet. Das Unternehmen hinter der künstlichen Intelligenz, OpenAI, sammelte Feedback und speicherte die Interaktionen der User, um das KI-Modell weiter zu trainieren und zu verbessern.

Höherer Datenschutz bei ChatGPT-4: Alle Probleme gelöst?

Mit den aktuellen Versionen ChatGPT-4 und 4o geht OpenAI einen anderen Weg: Die Prompts werden laut Aussagen des Unternehmens nicht mehr für das unmittelbare Training der KI verwendet. Stattdessen basiert das Modell auf einem festen Datensatz, mit dem die KI trainiert wurde. Auch werden die Eingaben und Daten laut OpenAI weder an Dritte weitergegeben noch verkauft.

Das klingt eigentlich ja ganz gut. Stellt sich die Frage: Gibt es aktuell überhaupt Probleme mit dem Datenschutz – oder haben sich diese mit den neueren Versionen gelöst? Nun, so ganz harmlos ist das Thema ChatGPT und Datenschutz auch mit Version 4 und 4o nicht geworden.

Datenschutzverstöße von ChatGPT: Preisgabe persönlicher Daten und falsche Anschuldigungen

Erst im Dezember 2024 verhängte die italienische Datenschutzbehörde eine Geldstrafe von 15 Millionen Euro gegen OpenAI. Der Grund: Verstöße gegen die Datenschutz-Grundverordnung (DSGVO) aufgrund mangelhafter Transparenz bei der Datenverarbeitung und einer dafür nicht ausreichenden Rechtsgrundlage. Außerdem: Ein unzureichender Schutz von Nutzern unter 13 Jahren. Ausgangspunkt war eine Datenpanne, durch die persönliche Informationen in fremden Chats öffentlich wurden.

Auch im März 2025 ist der KI-Chatbot in den Schlagzeilen – erneut wegen einer Datenpanne. Der Chatbot erfand ein Verbrechen und dichtete dieses einer realen Person an. Der Norweger Arve Hjalmar Holmen stellte im August 2024 fest, dass ChatGPT ihn als zweifachen Kindsmörder bezeichnete. Er hätte zwei seiner drei Söhne ermordet und sei dafür zu einer 21-jährigen Haftstrafe verurteilt worden. Diese Behauptungen waren jedoch völlig frei erfunden.

SCHON GEWUSST?

Dass KI-Systeme wie ChatGPT häufiger halluzinieren, ist nichts Neues. Doch gerade, wenn es um persönliche Informationen realer Personen geht, wird es mehr als schwierig. Hier stellt sich die Frage, ob das hinter der KI stehende Unternehmen haftbar ist – schließlich ist es kein Leichtes, einmal gestreute Falschinformationen wieder aus dem Netz zu bekommen.

Im Namen des Norwegers hat der österreichische Datenschutzverein Noyb (“None of your Business”) Beschwerde eingereicht. Der Vorwurf: ChatGPT verstoße gegen den Grundsatz der Datenrichtigkeit gemäß Artikel 5 DSGVO.

Die Strafe für einen solchen Datenschutzverstoß beträgt bis zu 4 Prozent des weltweiten Vorjahresumsatzes. Im Falle von OpenAI wären das bei einem Umsatz von 3,7 Milliarden Dollar im Jahr 2024 satte 148 Millionen Dollar. Für das Geschäftsjahr 2025 wird der Umsatz des US-Unternehmens sogar auf 11,6 Milliarden geschätzt – das würde ein DSGVO-Bußgeld von bis zu 452 Millionen Dollar bedeuten. Ob OpenAI wirklich für die falschen Anschuldigungen seines Chatbots zur Rechenschaft gezogen wird, ist noch unklar.

Problematisch: Keine Korrektur fehlerhafter Angaben möglich

Das Problem beim Datenschutz von ChatGPT ist, dass die Rechte von betroffenen Personen aktuell nicht umfassend gewährleistet werden. Gemäß der DSGVO umfassen die Betroffenenrechte u. a.

- das Recht auf Datensparsamkeit

- den Grundsatz zur Datenrichtigkeit

- das Recht auf Berichtigung und Löschung

- das Recht auf Auskunft

Der Grundsatz der Datenrichtigkeit besagt etwa, dass Personen ein Recht darauf haben, dass nur wahre Informationen über sie verbreitet werden – und eine Berichtigung von falschen Angaben erfolgen muss. Kommt der Verursacher dem nicht nach, haben Betroffene Anspruch auf Entschädigung, wenn ihnen durch die Falschinformationen ein Schaden entstanden ist.

WAS IST DAS PROBLEM?

Bei ChatGPT haben Nutzer keine Möglichkeit, fehlerhafte Angaben korrigieren zu lassen. Nur eine Sperrung besteht für bestimmte Anfragen. Damit entfällt jedoch auch die Option, das Recht auf Berichtigung und Löschung geltend zu machen.

Open AI beruft sich auf einen Haftungsausschluss: Die Nutzer würden darauf hingewiesen, dass der KI-Chatbot Fehler machen könnte. Datenschützer sehen das aber anders. Zum einen sei der Hinweis unten im Chat (“ChatGPT kann Fehler machen. Überprüfe wichtige Informationen.”) unscheinbar. Zum anderen könne man sich als Unternehmen nicht einfach durch einen Disclaimer von seiner Verantwortung befreien.

2023 bemängelte auch schon die deutsche Datenschutzbehörde, dass OpenAI es betroffenen Personen nicht leicht mache, ihre DSGVO-Rechte durchzusetzen. Konsequenzen durch die hiesigen Aufsichtsbehörden gab es bislang jedoch nicht.

2. Auf welche Daten greift ChatGPT zu?

ChatGPT greift auf so ziemlich alles zu, was an Informationen im Internet auffindbar ist. Während die Vorgängerversionen noch auf Quellen bis 2021 beschränkt waren, kann ChatGPT-4 und sein Nachfolger 4o auch aktuelle Daten abrufen und verarbeiten. Allerdings ist das Wissen statisch und wird nicht automatisch aktualisiert. Für Echzeit-Informationen nutzt die KI die Web-Suche.

Zu den Trainingsdatensätzen, die allein bei ChatGPT-3 mehr als 500 Milliarden Wörter umfasst haben sollen, gehören Nachrichtenportale, Fachartikel, Regierungswebsiten, Wikipedia, Foren und Diskussionsplattformen.

Auf nicht-öffentliche Daten wie private Nachrichten, interne Unternehmensdokumente oder geschützte wissenschaftliche Arbeiten und Artikel hinter Paywalls hat ChatGPT hingegen keinen Zugriff.

GUT ZU WISSEN

Daten, die Rückschlüsse über Sie als Person zulassen, erhebt ChatGPT nicht bzw. nur dann, wenn Sie diese selbst eingeben. Das sollten Sie im Geschäftskontext aber ohnehin nicht tun – insbesondere, wenn es sich um sensible personenbezogene Daten handelt.

Der Grund dafür ist der Blackbox-Effekt. Dieser beschreibt das Problem, dass sich die Entscheidungsprozesse einer generativen KI wie ChatGPT oft kaum oder gar nicht erklären lassen. Selbst Datenwissenschaftler und Entwickler wissen nicht genau, warum generative künstliche Intelligenz tut, was sie tut. Daher lässt sich z. B. auch nicht genau sagen, was mit den eingegebenen Daten passiert – was dem Auskunftsrecht gemäß DSGVO widerspricht.

Solange es sich auch beim Thema Datenschutz um eine Blackbox handelt, sollten Sie darauf verzichten, personenbezogene Daten bei ChatGPT einzugeben. Das gilt insbesondere, wenn Sie die Anwendung geschäftlich nutzen, etwa um schneller professionelle E-Mails zu schreiben oder Berichte zusammenzufassen.

Wie Sie ChatGPT datenschutzkonform im Unternehmensalltag einsetzen können, erklären wir weiter unten im Artikel.

3. Kann ich verhindern, dass ChatGPT meine Daten zum Training verwendet?

Ja, das geht. In den aktuellen Versionen ChatGPT-4 und 4o können Sie selbst entscheiden, ob die KI die von Ihnen eingegebenen Daten zu Trainingszwecken nutzen darf oder nicht.

WICHTIG

Da Sie nicht genau wissen, was mit Ihren Daten passiert, sollten Sie ChatGPT untersagen, diese für das eigene Training zu nutzen – und zwar egal, ob Sie die KI privat oder in Ihrem Unternehmen verwenden.

Um zu verhindern, dass Ihre Daten genutzt werden, um das KI-Modell zu verbessern, haben Sie verschiedene Möglichkeiten, die wir Ihnen gleich genauer vorstellen. Bitte beachten Sie aber, dass sich die einzelnen Schritte durch Updates, neue Konfigurationen und Nachfolgemodelle ändern können. Die folgenden Anleitungen und Screenshots beruhen auf dem Stand von März 2025.

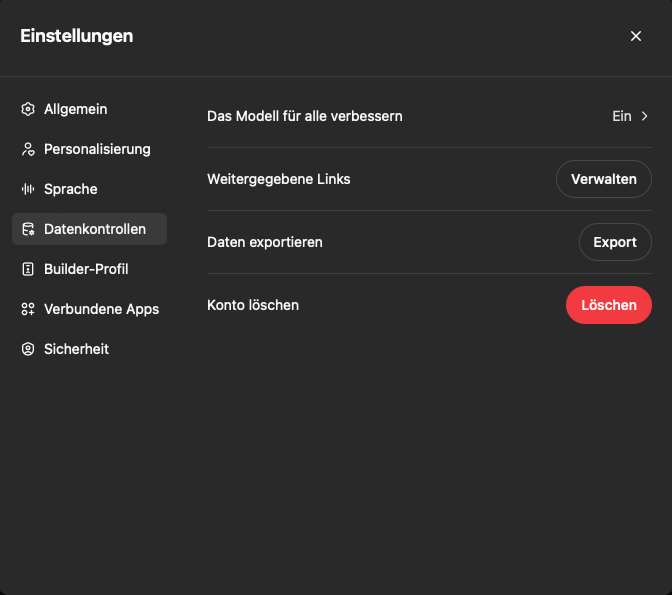

Möglichkeit 1: Training in Einstellungen deaktivieren

Um die Nutzung Ihrer Daten zu Trainingszwecken zu unterbinden, gehen Sie oben rechts auf Ihren Account und klicken auf den Reiter “Einstellungen” und von dort auf den Punkt “Datenkontrollen”. Es öffnet sich folgendes Bild:

Gehen Sie auf den Punkt “Das Modell für alle verbessern”. Es öffnet sich eine bereits aktivierte Schaltfläche mit der Erklärung “Erlaube uns, unsere Modelle mit deinen Inhalten zu trainieren, um ChatGPT für dich und alle, die es verwenden, noch besser zu machen (...).” Deaktivieren Sie die Schaltfläche. Ihre eingegebenen Daten und Chats werden nun nicht mehr zur Modellverbesserung genutzt.

Tipp: Unter dem Reiter “Sicherheit” können Sie die Multifaktor-Authentifizierung aktivieren, um die Sicherheit Ihres Account zu erhöhen.

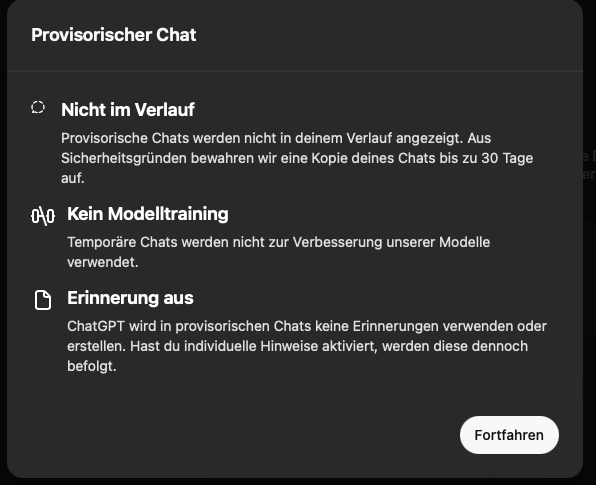

Möglichkeit 2: Provisorischer Chat

Alternativ können Sie im provisorischen Chat mit ChatGPT schreiben. Dieser Chat erscheint nicht in Ihrem Verlauf und wird auch nicht zum Training des KI-Modells verwendet.

GUT ZU WISSEN

Auch wenn die Daten im provisorischen Chat nicht zu Trainingszwecken genutzt werden, werden sie trotzdem noch für 30 Tage aufbewahrt, bevor sie gelöscht werden. Laut OpenAI geschieht das aus “Sicherheitsgründen”.

Sie finden den provisorischen Chat oben rechts direkt neben Ihrem Accountbild.

Möglichkeit 3: Training im Datenschutzportal deaktivieren

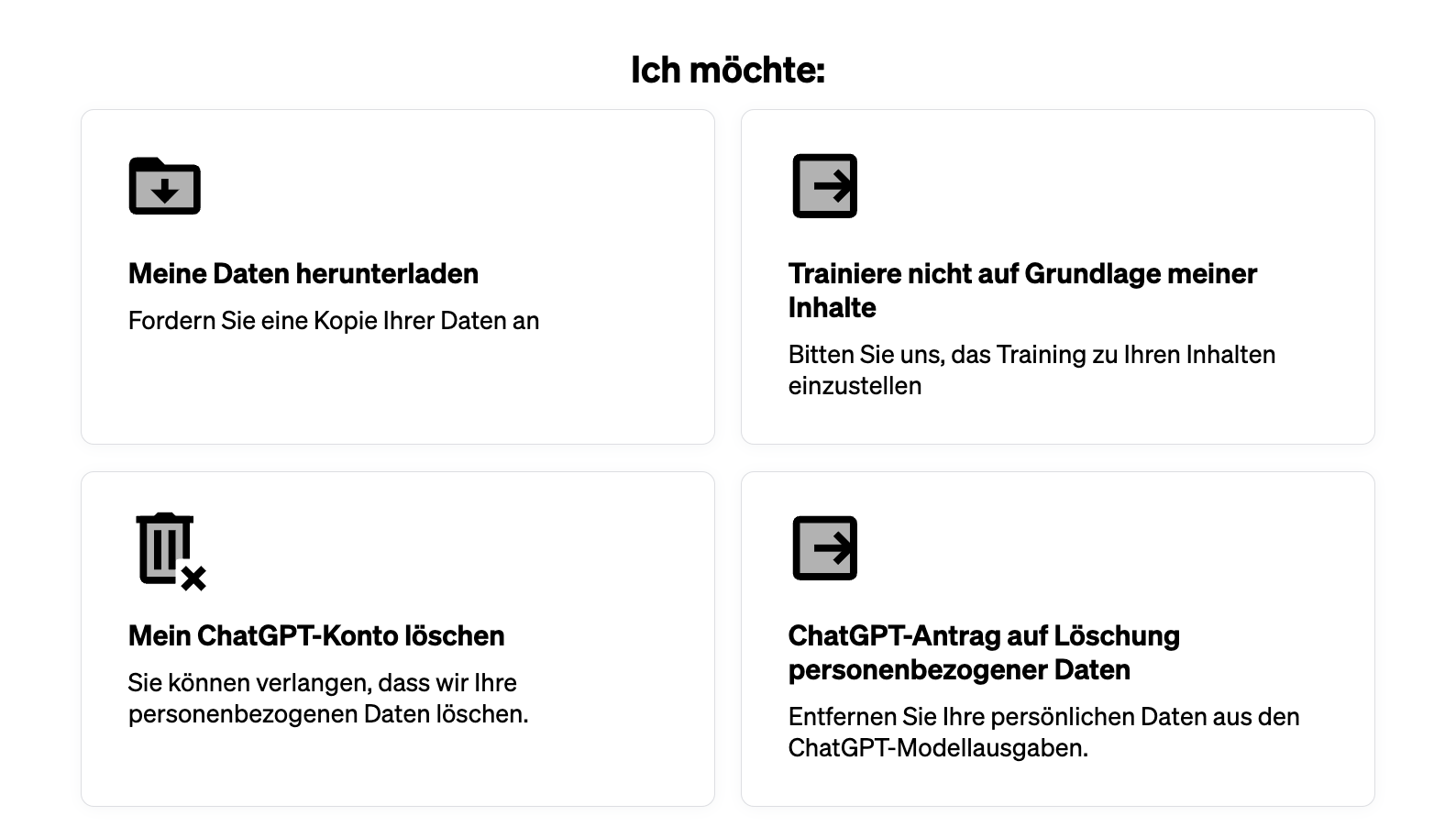

Möchten Sie nicht, dass Ihre Eingaben zu Trainingszwecken verwendet werden, aber sollen die Chats trotzdem im Verlauf erhalten bleiben, gibt es noch eine dritte Möglichkeit: Sie können das Training über das Datenschutzportal von OpenAI untersagen.

Gehen Sie dafür auf die Seite des Datenschutzportals (Sie können sich die Seite in Ihrem Browser automatisch auf Deutsch übersetzen lassen) und klicken Sie oben rechts auf die Schaltfläche “Stellen Sie eine Datenschutzanfrage”. Wählen Sie eine Möglichkeit aus, um Ihren Account zu verifizieren (z. B. E-Mail). Anschließend öffnet sich folgende Übersicht:

Wählen Sie den Punkt “Trainiere nicht auf Grundlage meiner Inhalte” aus, folgen Sie den Anweisungen und reichen Sie Ihre Anfrage ein.

PRAXIS-TIPP

Nutzen Sie Sora, die Bild-KI von OpenAI, können Sie auch hier das Datentraining im Menü unter Einstellungen oder im Datenschutzportal untersagen. Deaktivieren Sie das Training im Datenschutzportal für ChatGPT, gilt das auch für Sora. Einstellungen, die Sie nur in Ihrem ChatGPT-Account vornehmen, greifen hingegen nicht gleichzeitig für Sora.

4. Kann ich ChatGPT datenschutzkonform im Unternehmen einsetzen?

Das kommt darauf an. Grundsätzlich ist der Datenschutz bei ChatGPT bei den aktuellen Versionen und den Möglichkeiten, das Datentraining zu unterbinden, höher als bei den Vorgängermodellen. Dennoch müssen Sie als Verwender sicherstellen, dass die Daten, die Sie bei ChatGPT eingeben, sicher sind. Der Entzug der Erlaubnis zu Trainingszwecken ist ein erster Schritt. Mindestens genauso wichtig ist es, fremde, personenbezogene Daten – etwa von Kunden, Mitarbeitern oder Geschäftspartnern – erst gar nicht einzugeben.

Als Unternehmen müssen Sie sich an die Vorgaben der Datenschutz-Grundverordnung halten. Diese sieht vor, dass Sie für die Erhebung und Verarbeitung personenbezogener Daten die Zustimmung der betroffenen Personen benötigen.

Möchten Sie beispielsweise Kundenanfragen effizienter beantworten, indem Sie Antworten von ChatGPT generieren lassen, dürfen sich in den Prompts keine Daten befinden, die Rückschlüsse auf konkrete Personen zulassen, wie z. B. Name, Anschrift oder E-Mail-Adresse – zumindest nicht, wenn Sie keine ausdrückliche Einwilligung Ihrer Kunden eingeholt haben.

Pseudonymisieren Sie die Angaben. Das gilt auch, wenn Sie Dokumente mit Klarnamen wie z. B. eine Rechnung hochladen. Entfernen Sie vorher alle persönlichen Daten, sodass diese sich nicht mehr einer konkreten Person zuordnen lassen.

Neben personenbezogenen Daten sollten Sie und Ihre Mitarbeiter auch bei Unternehmensinterna vorsichtig sein. Die Eingabe von Betriebsgeheimnissen kann Geheimhaltungsverpflichtungen verletzen und nicht nur arbeitsrechtliche Konsequenzen nach sich ziehen, sondern auch gegen das Geschäftsgeheimnisgesetz (GeschGehG) verstoßen.

Ein datenschutzkonformer Einsatz von ChatGPT im Unternehmenskontext ist nur dann möglich, wenn Sie weder personenbezogene Daten noch Geschäftsgeheimnisse im Chat eingeben. Das gilt natürlich auch für sensible Bankinformationen, Kreditkartennummern oder Kundenadressen.

Schulen Sie Ihre Mitarbeiter im Umgang mit künstlicher Intelligenz – nicht nur, was den Datenschutz betrifft, sondern auch in anderen wichtigen Themen, wie z. B. KI und Urheberrecht und der KI-Kennzeichnungspflicht für Unternehmen.

Mit Inkrafttreten der KI-Verordnung ist die KI-Schulungspflicht seit Februar 2025 für alle Unternehmen Pflicht. Haben Sie Interesse an einer KI-Schulung, unterstützt Sie die eRecht24 Partnerkanzlei Siebert Lexow gern.

5. Wie steht es um den Datenschutz bei ChatGPT Enterprise und API?

Neben der kostenfreien Variante ChatGPT-3.5 und der kostenpflichtigen Variante ChatGPT Plus bzw. GPT-4 Turbo, hat Open AI mit ChatGPT Enterprise und der API auch unternehmensspezifische Anwendungen auf den Markt gebracht. Diese sollen nicht nur mehr Kontrolle über den Zugriff und die Funktionen des Chatbots geben, sondern auch höhere Sicherheitsstandards beim Datenschutz beinhalten.

Für die Business-ChatGPT-Versionen gilt laut OpenAI:

- Geschäftsdaten werden grundsätzlich nicht für das Modelltraining verwendet. Das Training ist deaktiviert und muss aktiv eingeschaltet werden, wenn Sie möchten, dass Ihre Daten zu Trainingszwecken verwendet werden dürfen.

- Sie können steuern, wie lange OpenAI Ihre Daten speichert und wann sie endgültig gelöscht werden.

- Die Daten werden ausschließlich verschlüsselt übertragen.

- OpenAI stellt Ihnen als Geschäftskunden einen AV-Vertrag gemäß Artikel 28 DSGVO zur Verfügung.

Geben Sie personenbezogene Daten bei ChatGPT ein, verarbeitet OpenAI diese in Ihrem Auftrag und gilt im Sinne der DSGVO als Auftragsverarbeiter. Dementsprechend benötigen Sie als Verantwortlicher für die Datenverarbeitung einen Auftragsverarbeitungsvertrag. Mit diesem regeln Sie u. a., welche Rechte und Pflichten sich für Sie und OpenAI ergeben, wenn Sie ChatGPT im Unternehmen einsetzen; welche Daten zu welchem Zweck erhoben werden und was nach Vertragsende mit diesen Daten passiert.

Für die Nutzung von ChatGPT Team, Enterprise und der API stellt Ihnen OpenAI einen AV-Vertrag unter der englischen Bezeichnung “Data Processing Addendum” (DPA) zur Verfügung.

ACHTUNG

Den AV-Vertrag gibt es nur für die Business-Anwendungen von ChatGPT. Sie haben zudem nur die Möglichkeit, das von OpenAI bereitgestellte Formular zu verwenden – eigene AV-Verträge akzeptiert OpenAI nicht. Sie können als Unternehmen also keinen individuellen Auftragsverarbeitungsvertrag über die Nutzung von ChatGPT abschließen.

6. Checkliste: So nutzen Sie ChatGPT (möglichst) datenschutzkonform im Unternehmen

Trotz der Möglichkeit, das KI-Training mit eigenen Daten zu unterbinden und zumindest mit der Unternehmenslizenz einen AV-Vertrag mit OpenAI abzuschließen, bleiben beim Thema ChatGPT und Datenschutz weiterhin rechtliche Hürden – beispielsweise beim Punkt Betroffenenrechte. Daher lässt sich die KI-Anwendung auch nur eingeschränkt datenschutzkonform im Unternehmen einsetzen. Wenn Sie die folgende Checkliste beachten, tun Sie jedoch bereits einiges für eine möglichst rechtssichere Verwendung.

- Keine sensiblen Daten eingeben: Geben Sie keine personenbezogenen Daten (z. B. Namen, E-Mail-Adressen oder Telefonnummern) ohne Zustimmung der betroffenen Personen ein.

- Rechtsgrundlage klären: Sollen personenbezogene Daten durch ChatGPT verarbeitet werden, brauchen Sie eine Rechtsgrundlage gemäß DSGVO (berechtigtes Interesse, Einwilligung oder Vertragserfüllung).

- Daten pseudonymisieren: Falls Daten verarbeitet werden müssen, sollten Sie diese vorher anonymisieren bzw. pseudonymisieren.

- Keine Unternehmensinformationen veröffentlichen: Geben Sie keine vertrauenswürdigen internen Informationen wie Finanzdaten oder Geschäftsgeheimnisse ein.

- AV-Vertrag abschließen: Wenn Sie eine Geschäftslizenz von ChatGPT wie ChatGPT Enterprise nutzen, schließen Sie einen AV-Vertrag mit OpenAI ab.

- Mitarbeiter schulen: Schulen Sie Ihre Angestellten im Umgang mit KI-Tools und Datenschutz und klären Sie sie über rechtliche Risiken auf.

- Interne KI-Richtlinien erstellen: Definieren Sie Regeln für den datenschutzkonformen Einsatz mit ChatGPT und lassen Sie die KI-Richtlinie von allen Mitarbeitern unterschreiben, die KI im Unternehmen nutzen.

- Offenlegen, dass KI genutzt wird: Stammen Inhalte (z. B. auf der Firmenwebsite) von ChatGPT, sollten Sie transparent sein und dies kenntlich machen.

- Keine geschützten Inhalte verwenden: Stellen Sie sicher, dass KI-generierte Texte, Bilder oder Code keine fremden Urheberrechte verletzen. Beachten Sie, dass Sie selbst keine Urheberrechte an KI-generierten Inhalten haben.

Das Thema KI wird laut diskutiert und birgt für viele Unternehmen noch große rechtliche Unsicherheiten und offene Fragen. Wir von eRecht24 helfen, Licht ins Dunkle zu bringen. Mit eRecht24 Premium bieten wir Ihnen Hintergrundwissen, Premium-Tools und Webinare zu Themen wie “KI-Verordnung, ChatGPT & Co: KI rechtssicher im Unternehmen einsetzen”. Außerdem können Sie in unserem Projekt-Manager eine KI-Richtlinie erstellen, mit der Sie regeln können, was Ihre Mitarbeiter im Umgang mit ChatGPT dürfen – und was nicht. Sichern Sie sich noch heute ab und machen Sie Ihr Unternehmen fit in Sachen KI und Datenschutz.